研究室紹介 |

移動ロボットのための安全かつ効率的な局所的経路計画 |

ヒューマノイドロボットの実時間全身動作生成 |

ヒューマノイドロボットによる作業中の接触力を考慮した動作生成 |

対人サービスにおけるアンドロイドロボットの美しい所作の生成 |

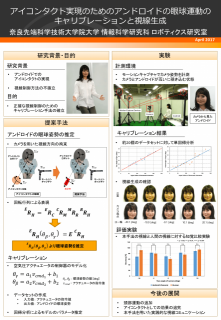

アイコンタクト実現のためのアンドロイドの眼球運動のキャリブレーションと視線生成 |

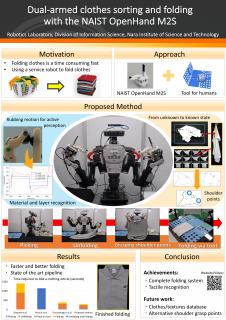

Dual-armed clothes sorting and folding with the NAIST OpenHand M25 |

ロボットアームによる容器形状を考慮したすくい動作の生成 |

Tactile-based Pouring Motion Inspired by Human Skill |

アクティブロボットにおけるタッチ技術の実装と評価 |

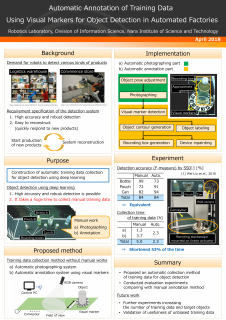

Automatic Annotation of Training Data Using Visual Markers for Object Detection in Automated Factories |

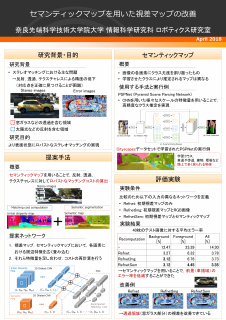

セマンティックマップを用いた視差マップの改善 |

セマンティックオブジェクト獲得のための一人称視点RGB-D映像を用いた手動作の識別 |

距離センサアレイを用いた前腕形状計測に基づく手の動作認識 |

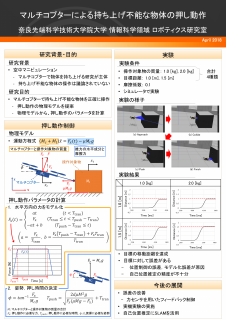

マルチコプターによる持ち上げ不能な物体の押し動作 |

Eye Tracking through Corneal Surface Reflection |

生活時間推定のための移動ロボットを用いた人の注視物体推定 |